投递人 itwriter 发布于 2017-12-20 14:30

文/脑极体

当我们一直在讨论 AI 能给互联网安全带来什么影响的时候,可能一直都忽略了一个问题:AI 本身也不安全。

这两天的新闻恰如其分地提醒了我们这一点。近日,谷歌被爆其机器学习框架 TensorFlow 中存在的严重安全风险,可被黑客用来制造安全威胁,谷歌方面已经确认了该漏洞并做出了整改回应。

虽然是提前发现,这些漏洞本身没有带来实质威胁。但这条消息还是让我们看到了某种蠢蠢欲动的不安。TensorFlow、Torch、Caffe 这些机器学习开发框架,差不多是如今 AI 开发者与研究者的标准配置,但这些平台最近却纷纷被爆出存在安全漏洞和被黑客利用的可能性。

某种意义上来说,这些消息在提醒我们同一个问题:当我们急切的将资金与用户关系聚集在机器学习周围时,也可能是将巨大的危险捆绑在了身上。

更重要的是,面临 AI 安全问题,我们中的大部分人还处在很傻很天真的“懵懂状态”,对它的逻辑和危害性近乎一无所知。

本文希望来科普一下这些内容,毕竟防患于未然,等到真正出现大事件再惊叹也就晚了。另外必须提醒开发者和企业的是,在谷歌这些大公司不遗余力的推广自家机器学习平台,并且为了吸引使用者而快速迭代、大量发布免费资源时,开发者本身一定要留个心眼,不能不假思索的使用。

比起心血毁于一旦,更多的审查机制和更严密的安全服务是非常值得的。

盲点中的魔鬼:机器学习框架的安全隐患

说机器学习平台的漏洞,有可能让开发者心血付诸东流绝不是开玩笑。在今年上半年的勒索病毒事件里,我们已经见识过了如今的黑客攻击有多恐怖。而勒索病毒本身就是利用了微软系统中的漏洞,进行针对式攻击锁死终端。

可以说,在勒索病毒的洗礼之后,信息产业已经进入了“漏洞霸权时代”。只要拥有了更多漏洞,就拥有了大范围的控制权与支配权。随着黑客攻击的工具化和门槛降低,能力一般的攻击者也可以利用平台漏洞发动广泛攻击。

但在我们愈发重视“漏洞产业”带给今天世界的安全隐患时,却不自主的产生了一个视线盲区。那就是人工智能。

这里普及一下今天大部分 AI 开发任务的基本流程:一般来说,一个开发者想要从头开始开发深度学习应用或者系统,是一件极其麻烦,几乎不可能的事。所以开发者会选择利用主流的开发框架。比如这次被爆出隐患的谷歌 TensorFlow。

利用这类平台,开发者可以用平台提供的 AI 能力,结合开源的算法与模型,训练自己的 AI 应用。这样速度快效率高,也可以吸收最先进的技术能力。这种“不能让造车者从开发轮子做起”的逻辑当然是对的,但问题也随之到来了:假如轮子里面有问题呢?

由于大量开发者集中利用机器学习框架训练 AI 是近两年的事情,此前也没有爆出过类似平台存在安全问题,所以这个领域的安全因素一直没有被重视过,可能大部分 AI 开发者从来都没有想过会存在安全问题。

但这次被发现的漏洞却表明:利用 TensorFlow 本身的系统漏洞,黑客可以很容易的制造恶意模型,从而控制、篡改使用恶意文件的 AI 应用。

由于一个投入使用的深度学习应用往往需要复杂的训练过程,所以恶意模型的攻击点很难短时间被察觉。但由于智能体内部的逻辑关联性,一个点被黑客攻击很可能将会全盘受控。这种情况下造成的安全隐患,显然比互联网时代的黑客攻击更加严重。

理解了这些,我们可能会达成一个并不美好的共识:我们一直在担心的 AI 失控,可能根本不是因为 AI 太聪明想夺权,而是居心不良的黑客发动的。

AI“失控”:一个今天不得不面对的问题

相比于经典计算的信息存储与交互模式,人工智能,尤其是机器学习类任务,最大的改变之一就是展现出了信息处理的整体性和聚合性。比如著名 AlphaGo,它不是对每种棋路给出固定的应对模式,而是对棋局进行预判和自我推理。它的智慧不是若干信息组成的集合,而是一个完整的“能力”。

这是 AI 的优点,但很可能也是 AI 的弱点。试想,假如 AlphaGo 中的某个训练模型被黑客攻击了,让系统在该打吃的时候偏偏就不。那么最终展现出的将不是某个棋招运算失当,而是干脆一盘棋也赢不了。

说白了,AI 注定是一个牵一发动全身的东西,所以平台漏洞带来的安全风险才格外可怕。

AlphaGo 毕竟还只是封闭的系统,即使被攻击了大不了也就是下棋不赢。但越来越多的 AI 开始被训练出来处理真实的任务,甚至极其关键的任务。那么一旦在平台层面被攻克,将带来无法估计的危险。

比如说自动驾驶汽车的判断力集体失灵、IoT 体系被黑客控制、金融服务中的 AI 突然瘫痪、企业级服务的 AI 系统崩溃等等情况,都是不出现还好,一旦出现就要搞个大事情。

由于 AI 系统紧密而复杂的连接关系,很多关键应用将从属于后端的 AI 体系,而这个体系又依赖平台提供的训练模型。那么一旦最后端的平台失守,几乎必然引发规模化、连锁式的崩盘——这或许才是我们今天最应该担心的 AI 失控。

AI 产业的风险,在于某个黑客一旦攻克了机器学习平台的底层漏洞,就相当于把整个大厦的最下一层给炸掉。这个逻辑此前很少被人关注,却已经被证明了其可能性存在。而最可怕的是,面对更多未知的漏洞和危险,世界范围内的 AI 开发者近乎是束手无策的。

家与国:无法逃避的 AI 战略角力

在认识到 AI 开发平台可能出现的底层问题,以及其严重的危害性之后,一个顺理成章的联想也会浮出我们的脑海:国家层面的 AI 安全与战略角力。

有人说,百度等公司代表的中国 AI 力量崛起,已经让美国科技界感到了威胁。事实上,这种角力绝不只是存在于产业层面。今年 7 月,哈佛大学肯尼迪政治学院贝尔弗科学与国际事务中心发布的《人工智能与国家安全》报告里,就专门指出 AI 很可能在接下来一段时间内,对多数国民产业形成革命性的影响,成为产业中的关键应用。那么一旦 AI 安全受到威胁,整个美国经济将受到重大打击。

同样的道理,当然也适用于今天与美国抗衡的 AI 大国,中国。这次 TensorFlow 安全漏洞曝光后,我们联系了一家国内机器视觉方向的创业公司,他们所使用的训练模型全部来自于 TensorFlow 中的社区分享。沟通之后的结论是,如果真受到黑客恶意模型的袭击,他们的产品将瞬间瘫痪。

这仅仅是一家创业公司,据了解,国内使用 TensorFlow 进行训练的还包括京东、小米、中兴等大型企业,以及不少科研院所的研发项目。未来,很有可能还有更多更重要的中国 AI 项目在欧美的平台上进行训练部署,当这些东西暴露在黑客攻击的面前,甚至控制权掌握在别国手中,我们真的可以放心这样的 AI 发展之路吗?

这也绝不是杞人忧天。勒索病毒爆发之后,追根溯源就会发现,这些黑客工具的源头来自美国情报系统研发的网络攻击武器。武器这种东西,制造出来就是为了杀伤的,无论是制造者使用,还是被盗后流出,最终吃亏的只能是没有防范的那群人。

各种可能性之下,AI 安全问题在今天已经绝不是儿戏。而中国产业至少能做两件事:1 是组建专业的 AI 防护产业,将互联网安全升级为 AI 安全;2 是必须逐步降低对欧美平台的依赖度,这里当然不是民粹主义的闭关锁国。而是应该给开发者更多选择,让整个产业自然而然地向国家 AI 安全战略靠拢。比如百度打造的从芯片到框架,再到平台体系与安全监督机制的开发者赋能计划,就在一步步将本应属于中国的 AI 开发根基留在中国。

总之,AI 本身的安全防护,已经成为了开发者必须在意、大平台需要承担责任、国家竞争需要争抢的一个环节。希望最终一起人为的 AI 失控事件都不要到来。毕竟吃一堑长一智的事情在互联网历史上已经发生太多了。

希望这次我们可以预见危险,而不是痛而后悟吧。

来自: 新浪科技

延伸阅读:

你的密码已形同虚设 强敌面前它该退休了

威锋网

2017-12-20 14:58

昨天晚上爆出一则大新闻,暗网监测公司 4iQ 在暗网上发现了包含14亿个账号邮箱的数据包,而这也成为了迄今为止最大的数据库泄漏事件,全世界近1/5的人可能会受到影响。不过或许不少人看到这则新闻时都和小编一样无动于衷,毕竟密码泄露问题已经司空见惯,所以今天我们不如换个角度,来聊聊“账号密码”该不该走进历史的垃圾桶。

暗网是什么,为何会有密码数据库呢?

我们就从这次暗网上出现的数据库说起吧!该数据库是12月5日在暗网上发现的,4iQ 公司表示该数据库不仅包含14亿个账号密码信息,而且查找机制十分完善,小白用户都能在几秒钟内搜索到自己想要的账号密码,比如搜索 admin 账号时,马上就检索到了226631个密码。虽然业内人士表示这个库可能仅仅是过去泄露数据的一个合集,但是因为范围广、门槛低,或许会成为网络犯罪的工具。并且4iQ 公司还表示,这个数据库中有14%的登陆证书是从未公开过的,也就是最近被盗的数据。

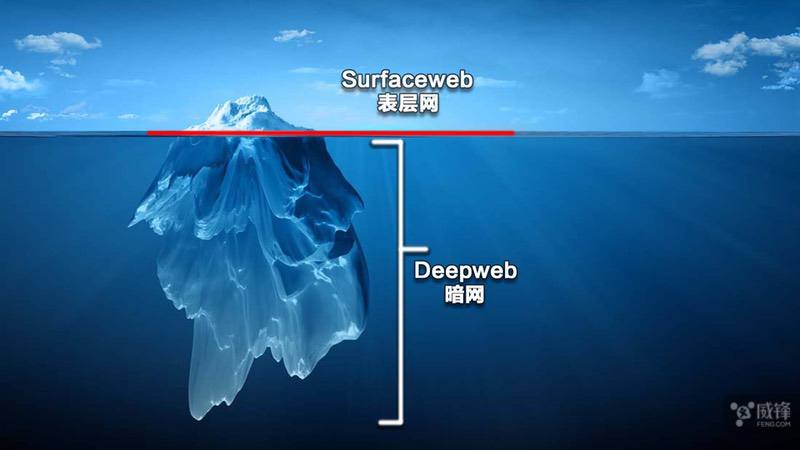

或许这里还需要为大家插播一下暗网的科普,暗网也叫做“DeepWeb”,这个名字也是将暗网类比为“互联网冰山”水下隐藏的部分,这一部分无法被普通用户看到,搜索引擎也无法获知内部的信息,只能通过加密的隐身软件才能进入。暗网来自于一个叫做 Tor 的开源项目,通过三位科学家发明的“隐藏路由信息”的功能实现,用户可以接入互联网但是却不用向任何服务器和路由器提交设备信息,所以就成了一个避开监管、完全隐藏在黑暗下的上网方式。

据说暗网的内容占据了全网的96%,而我们平时所能看到的互联网,仅仅是全网4%的信息罢了。虽然96%的内容中绝大多数是垃圾内容,但是因为匿名特性,暗网成为了世界性的违法交易平台,人们在暗网上通过比特币等加密货币进行交易。比起毒品、军火、人口贩卖等交易,黑客卖一些数据信息反而显得很“纯良”了。

黑客有一万种方法获得你的账号密码,防不胜防

而前面被证实的14亿账户信息,也不过是暗网上数据库买卖的冰山一角罢了。如果有人真的想要破解你的账户,基本上是毫无难度可言的,并且只要一个用户在一家网站上的账户、密码信息被盗了,他几乎所有的账号都会受到威胁,因为“撞库”实在是太方便了。现在大家可能都习惯在不同的账户上都使用类似甚至是相同的密码,“撞库”指的是将网络上已经获得的账号密码去其他网站、银行等机构尝试登陆,成功率非常高。

其实现在很多机构已经知道账号密码的认证体系不可靠了,所以他们推出了手机验证码的验证方式,但是犯罪分子用“短信拦截”还有“伪基站”等方法都能够轻易破解这种认证体系,虽然效率比较低,但是长时间攻击的覆盖范围还是很广泛,并且因为这样的攻击方式伪装性强、即使是互联网的老手都很容易中招,所以反而比账号密码泄露的后果更加严重。

为了把账号密码模式发挥到极致,1Password 等密码管理软件出现了,我们可以用极其复杂、完全不同的密码和账号,而不用担心自己记不住,这下总不会怕被撞库了吧?但压死骆驼的最后一根稻草已经不远了,当量子计算普及的之日,就是账号密码认证体系被完全淘汰之时。

量子计算是压死密码体系的最后一根稻草

大家应该都知道,破解密码有一种最直接的方式——穷举法暴力破解,也就是通过无数次尝试来获取正确密码。但是这样的方式对计算机来说工作量实在太大,举个例子,如果要破解一个 RSA 密码系统(现阶段最强大的密匙加密方式之一),即使是超级计算机都需要60万年。就算是一个普通的10位密码系统,要用一台高性能服务器暴力破解也需要数十年时间,所以很少有黑客会用穷举法,但是当未来我们拥有量子计算机之后,暴力破解将会变成一件无比简单的事情。

中国的量子计算机技术世界领先水平

本周一,IBM 宣布他们已经开始了量子计算的实验,而摩根大通、奔驰、本田和三星等巨头都宣布将和 IBM 开始量子计算机的合作,这宣告了量子计算商业化的开始。而量子计算机因为每个比特“量子”都能处于叠加态,也就是多个状态,而现在的 CPU 每个逻辑电路在一个时间点只能显示0或者是1。就像在完成一项工作时,一个人只能独自完成,而另一个人会多重影分身一样,效率完全不是一个级别的。

根据相关资料,一个50量子比特的量子计算机,计算能力就达到了每秒一千万亿次计算,而现在全世界最庞大的“神威·太湖之光”超级计算机每秒运算能力为9.3亿亿次。50量子比特就达到最强超算1/100的计算能力了,量子计算机的效率可见一斑,如果要它来暴力破解,之前需要60万年攻破的 RSA 密码系统,相同存储能力的量子计算机只需要3个小时。

未来是属于生物识别的

在量子计算机面前,已经沿用数十年的密码系统就像在现代挖掘机面前的木栅栏,轻轻一碰就会轰然倒塌,所以我们距离告别账号密码验证方式已经不远了。那么下一代的验证方式是什么呢?当然是以指纹识别为首的生物验证啊!

生物识别技术的比对过程是完全基于本地的,我们最开始输入的生物信息被存储在机内的加密芯片中,而后面每一次比对信息都是将传感器采集的指纹和存储的指纹进行对比。这种基于实物(指纹、虹膜、人脸)的认证方式无法从网络攻破,除非拿到手机的同时伪造一个完全一样的指纹、虹膜或人脸。

这么看来,生物识别既能够避免被黑客获得后传上暗网,还阻断了量子计算暴力破解的漏洞,所以在未来,账号密码将会在短时间内被迅速淘汰,而生物识别技术,还有其他类似的很多“双因子验证”(密码结合实物,比如令牌、卡片)的认证方式会成为绝对的主流。

声明:本文由入驻搜狐号的作者撰写,除搜狐官方账号外,观点仅代表作者本人,不代表搜狐立场。

![SiS001! Board - [第一会所 关闭注册]](images/green001/logo.png)